机器学习算法系列(29):Sparsity and Some Basics of L1 Regularization

转载?自pluskid 的个?人博客

Sparsity 是当今机器?学习领域中的?一个重要话题。John La ?erty 和 Larry Wasserman 在 2006 年年的?一篇评论中提到:

Some current challenges … are high dimensional data, sparsity, semi-supervised learning,the relation between computation and risk, and structured prediction.

--John La ?erty and Larry Wasserman. Challenges in statistical machine learning.Statistica Sinica. Volume 16, Number 2, pp. 307-323, 2006.

Sparsity 的最重要的“客户”?大概要属 high dimensional data 了了吧。现在的机器?学习问题中,具有?非常?高维度的数据随处可?见。例例如,在?文档或图?片分类中常?用的 bag of words 模型?里里,如果词典的?大?小是?一百万,那么每个?文档将由?一百万维的向量量来表示。?高维度带来的的?一个问题就是计算量量:在?一百万维的空间中,即使计算向量量的内积这样的基本操作也会是?非常费?力力的。不不过,如果向量量是稀疏的的话(事实上在 bag of words 模型中?文档向量量通常都是?非常稀疏的),例例如两个向量量分别只有L 1和L 2个?非零元素,那么计算内积可以只使?用min (L 1,L 2)次乘法完成。因此稀疏性对于解决?高维度数据的计算量量问题是?非常有效的。

当然?高维度带来的问题不不?止是在计算量量上。例例如在许多?生物相关的问题中,数据的维度?非常?高,但是由于收集数据需要昂贵的实验,因此可?用的训练数据却相当少,这样的问题通常称为“small , large problem”--我们?一般?用 表示数据点的个数,?用 表示变量量的个数,即数据维度。当p >>n 的时候,不不做任何其他假设或者限制的话,学习问题基本上是没法进?行行的。

因为如果?用上所有变量量的话,p 越?大,通常会导致模型越复杂,但是反过来n ?又很?小,于是就会出现很严重的 over?tting 问题。例例如,最简单的线性回归模型:

f (X )=p

∑

j =1

使?用square loss 来学习的话,就变成最?小化如下的问题:

J (w )=1n n

∑i =1(y i ?f (x i ))2=1n

||y ?Xw ||2

这?里里X =(x 1,······,x n )T ∈R n ×p 是数据矩阵,?而y =(y 1,······,y n )T 是由标签组成的列列向量量。该问题具有解析解?w =(X T X )?1X T y 然?而,如果p >n 的话,矩阵X T X 将会不不是满秩的,?而这机器?学习算法系列列(29):Sparsity and Some Basics of L1 Regularization

个解也没法算出来。捉着更更确切地说,将会有?无穷多个解。也就是说,我们的数据不不?足以确定?一个解,如果我们从所有可?行行解随机选?一个的话,很可能并不不是很好地解,总?而?言之,我们过拟合了了。

解决 over?tting 最常?用的办法就是 regularization ,例例如著名的 ridge regression 就是添加?一个?2regularizer :

J R(w)=1

n

||y?Xw||2+λ||w||2

直观地看,添加这个regularizer会使得模型的解偏向于norm较?小的w。从凸优化的?角度来说,最?小化上?面这个J(w)等价于如下问题:

min w 1

n

||y?Xw||2

其中C和λ对应的是个常数。也就是说,也就是说,我们通过限制w的norm的?大?小实现了了对模型空间的限制,从?而在?一定程度上(取决于λ的?大?小)避免了了over?tting。不不过ridge regression并不不具有产?生稀疏解的能?力力,得到的系数w仍然需要数据中的所有特征才能计算预测结果,从计算量量上来说并没有得到改观。

不不过,特别是在像?生物或者医学等通常需要和?人交互的领域,稀疏的解除了了计算量量上的好处之外,更更重要的是更更具有“可解释性”。?比如说,?一个病如果依赖于 5 个变量量的话,将会更更易易于医?生理理解、描述和总结规律律,但是如果依赖于 5000 个变量量的话,基本上就超出?人?肉可处理理的范围了了。

在这?里里引?入稀疏性的?方法是?用L1regularization 代替L2regularization,得到如下的?目标函数:

J L(w)=1

n

||y?Xw||2+λ||w||1

该问题通常被称为LASSO(least absolute shrinkage and selection operator)。LASSO 仍然是?一个 convex optimization 问题,不不过不不再具有解析解。它的优良性质是能产?生稀疏性,导致w中许多项变成零。

可是,为什什么它能产?生稀疏性呢?这也是?一直让我挺感兴趣的?一个问题,事实上在之前申请学校的时候?一次电话?面试中我也被问到了了这个问题。我当时的回答是背后的理理论我并不不是很清楚,但是我知道?一个直观上的理理解。下?面我们就先来看?一下这个直观上的理理解。

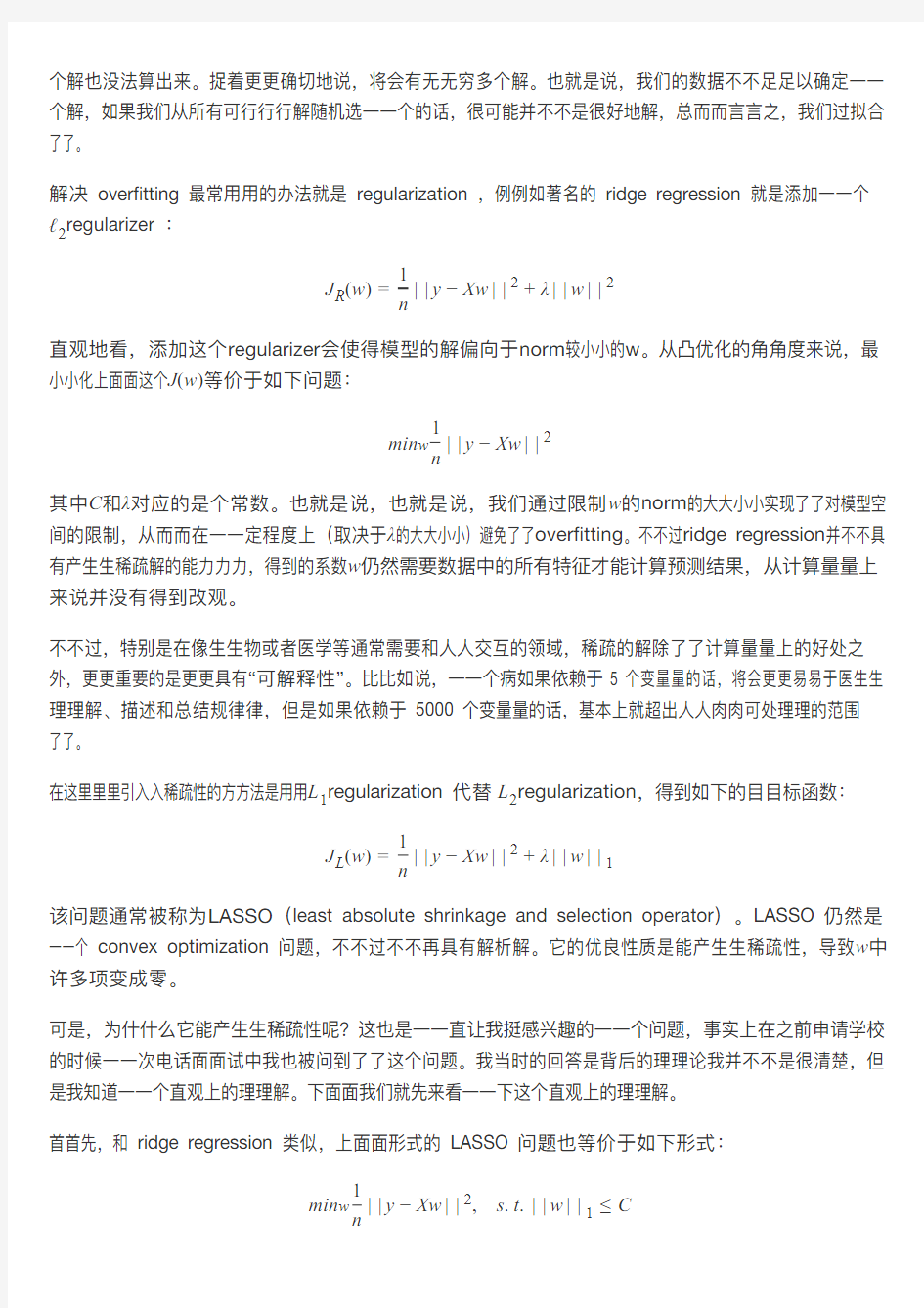

?首先,和 ridge regression 类似,上?面形式的 LASSO 问题也等价于如下形式:

min w 1

n

||y?Xw||2,s.t.||w||1≤C

也就是说,我们将模型空间限制在w的?一个?1-ball中。为了了便便于可视化,我们考虑两维的情况,在(w1,w2)平?面上可以画出?目标函数的等?高线,?而约束条件则成为平?面上半径为C的?一个 norm ball 。等?高线与 norm ball ?首次相交的地?方就是最优解。如图所示:

可以看到,?1?ball与?2?ball的不不同就在于他和每个坐标轴相交的地?方都有“?角”出现,?而?目标函数的测地线除?非位置摆得?非常好,?大部分时候都会在?角的地?方相交。注意到在?角的位置为产?生稀疏性,例例如图中的相交点就有w1=0,?而更更?高维的时候(想象?一下三维的?1-ball 是什什么样的?)除了了?角点以外,还有很多边的轮廓也是既有很?大的概率成为第?一次相交的地?方,?又会产?生稀疏性。

相?比之下,?2-ball 就没有这样的性质,因为没有?角,所以第?一次相交的地?方出现在具有稀疏性的位置的概率就变得?非常?小了了。这就从直观上来解释了了为什什么?1 regularization 能产?生稀疏性,?而?2 regularization 不不?行行的原因了了。

不不过,如果只限于 intuitive 的解释的话,就不不那么好玩了了,但是背后完整的理理论?又不不是那么容易易能够搞清楚的,既然这次的标题是 Basics ,我们就先来看?一个简单的特殊情况好了了。

接下来我们考虑 orthonormal design 的情况:1

X T X=I,然后看看LASSO的解具体是什什么样

n

?子。注意orthonormal design 实际上是要求特征之间相互正交。这可以通过对数据进?行行PCA以及模?长 normalize 来实现。

注意到LASSO 的?目标函数是 convex 的,根据KKT条件,在最优解的地?方要求 gradient 。不不过这?里里有?一点?小问题:?1 -norm 不不是光滑的,不不存在 gradient ,所以我们需要?用?一点subgradient 的东?西。

定义:(subgradient,subdi?erential).对于在p维欧式空间中的凸开?子集U上定义的实值函数f:U→R,?一个向量量p维向量量v称为f在?一点x0∈U处的subgradient,如果对于任意x∈U,满?足

f(x)?f(x0)≥v·(x?x0)

由在点x0处的所有subgradient所组成的集合称为x0处的subdi?erential,记为?f(x0)

注意 subgradient 和 subdi?erential 只是对凸函数定义的。例例如?一维的情况,f(x)=|x|,在x=0处的subdi?erential 就是[?1,+1]这个区间(集合)。注意在f的 gradient 存在的点,

subdi?erential 将是由 gradient 构成的?一个单点集合。这样就将 gradient 的概念加以推?广了了。这个推?广有?一个很好的性质。

性质(CONDITION GLOBAL MINIMIZER).点x0是凸函数f的?一个全局最?小值点,当且仅当

0∈?f(x0)

证明很简单,将0∈?f(x0)带?入定义的那个式?子就可以得到。有了了这个?工具之后,就可以对LASSO 的最优解进?行行分析了了。在此之前,我们先看?一下原始的 least square 问题的最优解现在变成了了什什么样?子,由于 orthonormal design ,我们有

?w=1

n

X T y

然后我们再来看LASSO,假设ˉw=(ˉw1,······,ˉw p)T是J L(w)的全局最优值点。考虑第j个变量量ˉw j,有两种情况。

第?一种情况:gradient存在,此时ˉw j≠0

由于gradient在最?小值点必须等于零,我们有

?J L(w)?w j |ˉw

j

=0

亦即

?2

n

(X T y?X T Xˉw)j+λsign(ˉw j)=0

根据orthonormal design性质以及least square问题在orthonormal design时的解?w j化简得到

ˉw j=?w j?λ

2

sign(ˉw j)

从这个式?子也可以明显地看出ˉw j和?w j是同号的,于是sign(ˉw j)=sign(?w j)所以上?面的式?子变为

ˉw j=?w j?λ

2

sign(ˉw j)=sign(?w j)(|?w j|?

λ

2

)

再?用?一次sign(ˉw j)=sign(?w j),两边同时乘以sign(ˉw j),可以得到

|?w j|?λ

2

=|ˉw j|≥0

于是刚才的式?子可以进?一步写成

ˉw j=sign(?w j)(|?w j|?λ

2 )+

这?里里(x)+=max{x,0}表示x的正部。

第?二种情况:gradient不不存在,此时ˉw j=0根据subgradient在最?小值点出的性质,此时有:0=ˉw j∈?J L(ˉw)={?2n(X T y?X T Xˉw)j+λe:e∈[?1,1]}

亦即存在e0∈[?1,1]使得

0=2ˉw j?2?w j+λe0

于是

|?w j|=λ

2

|e0|≤

λ

2

?又因为ˉw j=0,所以这个时候式?子也可以统?一为

ˉw j=sign(?w j)(|?w j|?λ

2 )+

的形式。

如此?一来,在 orthonormal design 的情况下,LASSO 的最优解就可以写为

ˉw j=sign(?w j)(|?w j|?λ

2 )+

,可以?用图形象地表达出来。

图上画了了原始的 least square 解,LASSO 的解以及 ridge regression 的解,?用上?面同样的?方法(不不过由于 ridge regularizer 是 smooth 的,所以过程却简单得多)可以得知 ridge regression 的解是如下形式

n

?w j

1+nλ

可以认为ridge regression 只是做了了?一个全局缩放,?而 LASSO 则是做了了?一个 soft thresholding :的那些系数直接变成零了了,这也就更更加令?人信服地解释了了 LASSO 为何能够产?生将绝对值?小于λ

2

稀疏解了了。

机器视觉检测的分析简答作业及答案要点学习资料

2012研究生机器视觉课程检测及课程设计内容 一、回答下列问题: 1、什么是机器视觉,它的目标是什么?能否画出机器视觉检测系统的结构方 块图,并说出它们的工作过程原理和与人类视觉的关系? 机器视觉是机器(通常指计算机)对图像进行自动处理并报告“图像中有什么”的过程,也就是说它识别图像中的内容。图像中的内容往往是某些机器零件,而处理的目标不仅要能对机器零件定位,还要能对其进行检验。 原始数据特征向量类别标识 特征度量模式分类器 机器视觉系统的组成框图 2、在机器视觉检测技术中:什么是点视觉技术、一维视觉技术、二维视觉技 术、三维视觉技术、运动视觉技术、彩色视觉技术、非可见光视觉技术等? 能否说出他们的应用领域病句、案例?能否描述它们的技术特点? 答:点视觉:用一个独立变量表示的视觉称之为点视觉。如应用位移传感器测量物体的移动速度。 一维视觉:普通的CCD。 两维视觉:用两个独立变量表示的视觉称之为两维视觉。比如普通的CCD。 三维视觉:用三个独立变量表示的视觉称之为三维视觉。比如用两个相机拍摄(双目视觉);或者使用一个相机和一个辅助光源。 彩色视觉:用颜色作为变量的视觉称之为彩色视觉。物体的颜色是由照 射光源的光谱成分、光线在物体上反射和吸收的情况决定的。比如,一 个蓝色物体在日光下观察呈现蓝色,是由于这个物体将日光中的蓝光 反射出来,而吸收了光谱中的其他部分的光谱,而同样的蓝色物体, 在红色的光源照射下,则呈现红紫色, 非可见光视觉技术:用非可见光作为光源的视觉技术。比如非可见光成像技术。

3、机器视觉检测技术中:光源的种类有哪些?不同光源的特点是什么?光照 方式有几种?不同光照方式的用途是什么?又和技术特点和要求? 机器视觉检测技术中光源有以下几种:荧光灯,卤素灯+光纤导管,LED 光源,激光,紫外光等。几种光源的特点如下: 成本亮度稳定度使用寿命复杂设计温度影响种类名 称 荧光灯低差差一般低一般 卤素灯+光纤导管高好一般差一般差LED光源一般一般好好高低光照方式有以下几种: 背景光法(背光照射)是将被测物置于相机和光源之间。这种照明方式的优点是可将被测物的边缘轮廓清晰地勾勒出来。由于在图像中,被测物所遮挡的部分为黑色,而未遮挡的部分为白色,因此形成“黑白分明”的易于系统分析的图像。此方法被应用于90%的测量系统中。 前景光法(正面照射)是将灯源置于被测物和相机之前。又可分为明场照射和暗场照射。明场照射是为了获得物体的几乎全部信息,照射物体的光在视野范围之内几乎全部反射回去;暗场照射是为了获取物体表面的凹凸,照射物体的光在视野范围之外有部分光反射回去。 同轴光法是将灯源置于被测物和相机之间。 4、机器视觉检测系统中,光学系统的作用是什么?光学器件有哪几种,它们 各自的作用是什么?光学镜头有几种类型,它们各自有何用途?光学镜头有哪些技术参数,各自对测量有什么影响? 答:机器视觉检测系统中,光学系统用来采集物体的轮廓、色彩等信息。 光学器件主要有:镜头、成像器件(CCD和CMOS)、光圈、快门等。 镜头的作用是对成像光线进行调焦等处理,使成像更清晰;成像器件的作用是将光学图像转换成模拟电信号;光圈的作用如同人得瞳孔, 控制入射光的入射量,实现曝光平衡;快门的作用是将想要获取的光学

机器学习的十种经典算法详解

机器学习的十种经典算法详解 毫无疑问,近些年机器学习和人工智能领域受到了越来越多的关注。随着大数据成为当下工业界最火爆的技术趋势,机器学习也借助大数据在预测和推荐方面取得了惊人的成绩。比较有名的机器学习案例包括Netflix根据用户历史浏览行为给用户推荐电影,亚马逊基于用户的历史购买行为来推荐图书。那么,如果你想要学习机器学习的算法,该如何入门呢?就我而言,我的入门课程是在哥本哈根留学时选修的人工智能课程。老师是丹麦科技大学应用数学和计算机专业的全职教授,他的研究方向是逻辑学和人工智能,主要是用逻辑学的方法来建模。课程包括了理论/核心概念的探讨和动手实践两个部分。我们使用的教材是人工智能的经典书籍之一:Peter Norvig教授的《人工智能——一种现代方法》,课程涉及到了智能代理、基于搜索的求解、对抗搜索、概率论、多代理系统、社交化人工智能,以及人工智能的伦理和未来等话题。在课程的后期,我们三个人还组队做了编程项目,实现了基于搜索的简单算法来解决虚拟环境下的交通运输任务。我从课程中学到了非常多的知识,并且打算在这个专题里继续深入学习。在过去几周内,我参与了旧金山地区的多场深度学习、神经网络和数据架构的演讲——还有一场众多知名教授云集的机器学习会议。最重要的是,我在六月初注册了Udacity的《机器学习导论》在线课程,并且在几天前学完了课程内容。在本文中,我想分享几个我从课程中学到的常用机器学习算法。机器学习算法通常可以被分为三大类——监督式学习,非监督式学习和强化学习。监督式学习主要用于一部分数据集(训练数据)有某些可以获取的熟悉(标签),但剩余的样本缺失并且需要预测的场景。非监督式学习主要用于从未标注数据集中挖掘相互之间的隐含关系。强化学习介于两者之间——每一步预测或者行为都或多或少有一些反馈信息,但是却没有准确的标签或者错误提示。由于这是入门级的课程,并没有提及强化学习,但我希望监督式学习和非监督式学习的十个算法足够吊起你的胃口了。监督式学习1.决策树:决策树是一种决策支持工具,它使用树状图或者树状模型来表示决策过程以及后续得到的结果,包括概率事件结果等。请观察下图来理解决策树的结构。 从商业决策的角度来看,决策树就是通过尽可能少的是非判断问题来预测决策正确的概

机器学习中常见的几种优化方法

机器学习中常见的几种优化方法 阅读目录 1. 梯度下降法(Gradient Descent) 2. 牛顿法和拟牛顿法(Newton's method & Quasi-Newton Methods) 3. 共轭梯度法(Conjugate Gradient) 4. 启发式优化方法 5. 解决约束优化问题——拉格朗日乘数法 我们每个人都会在我们的生活或者工作中遇到各种各样的最优化问题,比如每个企业和个人都要考虑的一个问题“在一定成本下,如何使利润最大化”等。最优化方法是一种数学方法,它是研究在给定约束之下如何寻求某些因素(的量),以使某一(或某些)指标达到最优的一些学科的总称。随着学习的深入,博主越来越发现最优化方法的重要性,学习和工作中遇到的大多问题都可以建模成一种最优化模型进行求解,比如我们现在学习的机器学习算法,大部分的机器学习算法的本质都是建立优化模型,通过最优化方法对目标函数(或损失函数)进行优化,从而训练出最好的模型。常见的最优化方法有梯度下降法、牛顿法和拟牛顿法、共轭梯

度法等等。 回到顶部 1. 梯度下降法(Gradient Descent) 梯度下降法是最早最简单,也是最为常用的最优化方法。梯度下降法实现简单,当目标函数是凸函数时,梯度下降法的解是全局解。一般情况下,其解不保证是全局最优解,梯度下降法的速度也未必是最快的。梯度下降法的优化思想是用当前位置负梯度方向作为搜索方向,因为该方向为当前位置的最快下降方向,所以也被称为是”最速下降法“。最速下 降法越接近目标值,步长越小,前进越慢。梯度下降法的搜索迭代示意图如下图所示: 牛顿法的缺点: (1)靠近极小值时收敛速度减慢,如下图所示; (2)直线搜索时可能会产生一些问题; (3)可能会“之字形”地下降。 从上图可以看出,梯度下降法在接近最优解的区域收敛速度明显变慢,利用梯度下降法求解需要很多次的迭代。 在机器学习中,基于基本的梯度下降法发展了两种梯度下降方法,分别为随机梯度下降法和批量梯度下降法。

机器学习常见算法分类汇总

机器学习常见算法分类汇总 ?作者:王萌 ?星期三, 六月25, 2014 ?Big Data, 大数据, 应用, 热点, 计算 ?10条评论 机器学习无疑是当前数据分析领域的一个热点内容。很多人在平时的工作中都或多或少会用到机器学习的算法。这里IT经理网为您总结一下常见的机器学习算法,以供您在工作和学习中参考。 机器学习的算法很多。很多时候困惑人们都是,很多算法是一类算法,而有些算法又是从其他算法中延伸出来的。这里,我们从两个方面来给大家介绍,第一个方面是学习的方式,第二个方面是算法的类似性。 学习方式 根据数据类型的不同,对一个问题的建模有不同的方式。在机器学习或者人工智能领域,人们首先会考虑算法的学习方式。在机器学习领域,有几种主要的学习方式。将算法按照学习方式分类是一个不错的想法,这样可以让人们在建模和算法选择的时候考虑能根据输入数据来选择最合适的算法来获得最好的结果。 监督式学习:

在监督式学习下,输入数据被称为“训练数据”,每组训练数据有一个明确的标识或结果,如对防垃圾邮件系统中“垃圾邮件”“非垃圾邮件”,对手写数字识别中的“1“,”2“,”3“,”4“等。在建立预测模型的时候,监督式学习建立一个学习过程,将预测结果与“训练数据”的实际结果进行比较,不断的调整预测模型,直到模型的预测结果达到一个预期的准确率。监督式学习的常见应用场景如分类问题和回归问题。常见算法有逻辑回归(Logistic Regression)和反向传递神经网络(Back Propagation Neural Network) 非监督式学习: 在非监督式学习中,数据并不被特别标识,学习模型是为了推断出数据的一些内在结构。常见的应用场景包括关联规则的学习以及聚类等。常见算法包括Apriori算法以及k-Means算法。 半监督式学习:

哪些问题适合于用机器学习来解决

哪些问题适合于用机器学习来解决 我们和大家分享了哪些问题适合于用机器学习来解决。在明确了问题之后我们就需要来解决问题,本文要描述的是产品经理在开发机器学习产品时所需要的能力。第一部分提到产品经理的核心能力并不会因为应用到机器学习技术而改变,而只是在某些方面需要有所加强。产品经理一般需要五种核心能力,包括客户共情/设计分解,沟通、合作、商业策略和技术理解力。在机器学习领域需要增强的可能是技术方面的理解能力,因为产品经理需要理解机器学习系统的操作才能做出较好的产品决策。你可以向工程师学习也可以通过书本和网络教程充电。但如果你对机器学习系统的运行没有很好的理解,那么你的产品很可能会遇到很多问题。 算法的局限性 机器学习使用的每一个算法都基于特定的任务进行优化,无法覆盖真实情况下每一个细微的差别。理解算法的能力和局限将会帮助你把握住用户体验中存在的差距,并且通过优化产品设计或算法来解决。这是作为产品经理必须要掌握的能力。关于算法的不足我们用几个例子来说明。 数据中的偏差 机器学习算法从数据中学习模式,所以数据的质量决定了算法的表现。机器学习产品需要面对的第一个挑战便是这些数据要能够充分代表你的用户。有一个很负面的例子,就是google将黑人兄弟识别成了大猩猩。 所以保证数据代表你所有的用户是产品成功的关键。有时候偏差的存在并不是来自于数据收集的错误,而是数据固有的特性。就像IBM沃森利用俚语的都市字典进行训练后会输出恶毒的语言一样。我们期待的是输出礼貌的语言,但机器学习却学到了语言集中不好的部分。所以在精训练的时候需要对数据进行一定的清晰。 另一个例子,一般发达国家的互联网人数相较于发展中国家多。如果你基于搜索次数对搜索习惯进行建模的话,就会得到发达国家更多的结果,那么建模就不能准确的反映各国人民的上网习惯了,例如非洲的用户。对于数据偏差的审视将帮助你意识到产品不希望出现

机器人视觉算法 参考答案

1.什么是机器视觉 【概述】 机器视觉就是用机器代替人眼来做测量和判断。机器视觉系统是指通过机器视觉产品(即图像摄取装置,分 CMOS 和 CCD 两种)将被摄取目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号;图像系统对这些信号进行各种运算来抽取目标的特征,进而根据判别的结果来控制现场的设备动作。 机器视觉系统的特点是提高生产的柔性和自动化程度。在一些不适合于人工作业的危险工作环境或人工视觉难以满足要求的场合,常用机器视觉来替代人工视觉;同时在大批量工业生产过程中,用人工视觉检查产品质量效率低且精度不高,用机器视觉检测方法可以大大提高生产效率和生产的自动化程度。而且机器视觉易于实现信息集成,是实现计算机集成制造的基础技术。 正是由于机器视觉系统可以快速获取大量信息,而且易于自动处理,也易于同设计信息以及加工控制信息集成,因此,在现代自动化生产过程中,人们将机器视觉系统广泛地用于工况监视、成品检验和质量控制等领域。【基本构造】 一个典型的工业机器视觉系统包括:光源、镜头、 CCD 照相机、图像处理单元(或图像捕获卡)、图像处理软件、监视器、通讯 / 输入输出单元等。 系统可再分为: 主端电脑(Host Computer) 影像撷取卡(Frame Grabber)与影像处理器影像摄影机 CCTV镜头显微镜头照明设备: Halogen光源 LED光源 高周波萤光灯源闪光灯源其他特殊光源影像显示器 LCD 机构及控制系统 PLC、PC-Base控制器 精密桌台伺服运动机台 【工作原理】 机器视觉检测系统采用CCD照相机将被检测的目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号,图像处理系统对这些信号进行各种运算来抽取目标的特征,如面积、数量、位置、长度,再根据预设的允许度和其他条件输出结果,包括尺寸、角度、个数、合格 / 不合格、有 / 无等,实现自动识别功能。 【机器视觉系统的典型结构】 一个典型的机器视觉系统包括以下五大块: 1.照明 照明是影响机器视觉系统输入的重要因素,它直接影响输入数据的质量和应用效果。由于没有通用的机器视觉照明设备,所以针对每个特定的应用实例,要选择相应的照明装置,以达到最佳效果。光源可分为可见光和不可见光。常用的几种可见光源是白帜灯、日光灯、水银灯和钠光灯。可见光的缺点是光能不能保持稳定。如何使光能在一定的程度上保持稳定,是实用化过程中急需要解决的问题。另一方面,环境光有可能影响图像的质量,所以可采用加防护屏的方法来减少环境光的影响。照明系统按其照射方法可分为:背向照明、前向照明、结构光和频闪光照明等。其中,背向照明是被测物放在光源和摄像机之间,它的优点是能获得高对比度的图像。前向照明是光源和摄像机位于被测物的同侧,这种方式便于安装。结构光照明是将光栅或线光源等投射到被测物上,根据它们产生的畸变,解调出被测物的三维信息。频闪光照明是将高频率的光脉冲照射到物体上,摄像机拍摄要求与光源同步。 2.镜头FOV(Field Of Vision)=所需分辨率*亚象素*相机尺寸/PRTM(零件测量公差比)镜头选择应注意: ①焦距②目标高度③影像高度④放大倍数⑤影像至目标的距离⑥中心点 / 节点⑦畸变 3.相机 按照不同标准可分为:标准分辨率数字相机和模拟相机等。要根据不同的实际应用场合选不同的相机和高分辨率相机:线扫描CCD和面阵CCD;单色相机和彩色相机。 4.图像采集卡 图像采集卡只是完整的机器视觉系统的一个部件,但是它扮演一个非常重要的角色。图像采集卡直接决定了摄像头的接口:黑白、彩色、模拟、数字等等。 比较典型的是PCI或AGP兼容的捕获卡,可以将图像迅速地传送到计算机存储器进行处理。有些采集卡有内置的多路开关。例如,可以连接8个不同的摄像机,然后告诉采集卡采用那一个相机抓拍到的信息。有些采集卡有内置的数字输入以触发采集卡进行捕捉,当采集卡抓拍图像时数字输出口就触发闸门。 5.视觉处理器 视觉处理器集采集卡与处理器于一体。以往计算机速度较慢时,采用视觉处理器加快视觉处理任务。现在由于采集

机器学习中各个算法的优缺点(一)

由于人工智能的火热,现在很多人都开始关注人工智能的各个分支的学习。人工智能由很多知识组成,其中人工智能的核心——机器学习是大家格外关注的。所以说,要想学好人工智能就必须学好机器学习。其中机器学习中涉及到了很多的算法,在这几篇文章中我们就给大家介绍一下关于机器学习算法的优缺点。 首先我们给大家介绍一下正则化算法,这是回归方法的拓展,这种方法会基于模型复杂性对其进行惩罚,它喜欢相对简单能够更好的泛化的模型。其中,正则化算法的例子有很多,比如说岭回归、最小绝对收缩与选择算子、GLASSO、弹性网络、最小角回归。而正则化算法的优点有两点,第一就是其惩罚会减少过拟合。第二就是总会有解决方法。而正则化算法的缺点也有两点,第一就是惩罚会造成欠拟合。第二就是很难校准。 接着我们给大家说一下集成算法,集成方法是由多个较弱的模型集成模型组,其中的模型可以单独进行训练,并且它们的预测能以某种方式结合起来去做出一个总体预测。该算法主要的问题是要找出哪些较弱的模型可以结合起来,以及结合的方法。这是一个非常强大的技术集,因此广受欢迎。这种算法的案例有很多,比如说Boosting、Bootstrapped Aggregation (Bagging)、AdaBoost、层叠泛化、梯度推进机、梯度提升回归树、随机森林。而集成算法的优点就是当前最先进的预测几乎都使用了算法集成,它比使用单个模型预测出来的结果要 精确的多。而缺点就是需要大量的维护工作。

然后我们给大家介绍一下决策树算法,决策树学习使用一个决策树作为一个预测模型,它将对一个 item(表征在分支上)观察所得映射成关于该 item 的目标值的结论(表征在叶子中)。而树模型中的目标是可变的,可以采一组有限值,被称为分类树;在这些树结构中,叶子表示类标签,分支表示表征这些类标签的连接的特征。决策树算法的案例有很多,比如说分类和回归树、Iterative Dichotomiser 3(ID3)、C4.5 和 C5.0。决策树算法的优点有两种,第一就是容易解释,第二就是非参数型。缺点就是趋向过拟合,而且可能或陷于局部最小值中,最后就是没有在线学习。 在这篇文章中我们给大家介绍了机器学习中涉及到的正则化算法、集成算法以及决策树算法的案例、优点以及缺点,这些知识都是能够帮助大家理解机器学习的算法,希望这篇文章能够帮助到大家。

数字图像处理与机器视觉 2015-2016期末试卷参考答案

数字图像处理与机器视觉 2015-2016期末试卷参考答案南昌大学研究生2015,2016年第2学期期末考试试卷 试卷编号: (开)卷课程名称: 数字图像处理与机器视觉适用班级: 2015级硕士研究生姓名: 学号: 专业: 学院: 机电工程学院考试日期: 题号一二三四五六七八九十总分累分人 签名题分 10 15 15 10 20 30 100 得分 考生注意事项:1、本试卷共4页,请查看试卷中是否有缺页或破损。如有请报告以便更换。 2、使用A4答题纸,注意装订线。 一、单项选择题(从下列各题四个备选答案中选出一个正确答案,并将其 代号填在题前的括号内。每小题1分,共10分) ( b )1.图像与灰度直方图间的对应关系是: a.一一对应 b.多对一 c.一对多 d.都不对 ( d )2. 下列算法中属于图象平滑处理的是: a.Hough变换法 b.状态法 c.高通滤波 d. 中值滤波 ( c )3.下列算法中属于图象锐化处理的是: a.局部平均法 b.最均匀平滑法 c.高通滤波 d. 中值滤波 ( d )4. 下列图象边缘增强算子中对噪声最敏感的是: a.梯度算子 b.Prewitt算子 c.Roberts算子 d. Laplacian算子 ( b )5. 下列算法中属于点处理的是: a.梯度锐化 b.二值化 c.傅立叶变换 d.中值滤波 ( d )6.下列算子中利用边缘灰度变化的二阶导数特性检测边缘的是:

a.梯度算子 b.Prewitt算子 c.Roberts算子 d. Laplacian算子 ( c )7.将灰度图像转换成二值图像的命令为: a.ind2gray b.ind2rgb c.im2bw d.ind2bw ( d )8.数字图像处理的研究内容不包括: a.图像数字化 b.图像增强 c.图像分割 d.数字图像存储 ( d )9.对一幅100?100像元的图象,若每像元用,bit表示其灰度值,经霍夫曼编码后图象的压缩比为2:1,则压缩图象的数据量为: a.2500bit b.20000bit c.5000bit d.40000bit ( b )10.图像灰度方差说明了图像哪一个属性: a.平均灰度 b.图像对比度 c.图像整体亮度 d.图像细节 第 1 页 二、填空题(每空1分,共15分) l. 图像处理中常用的两种邻域是 4-邻域和 8-邻域。 2.图象平滑既可在空间域中进行,也可在频率域中进行。 3.常用的灰度内插法有最近邻元法、双线性内插法和三次内插法。 4. 低通滤波法是使高频成分受到抑制而让低频成分顺利通过,从而实现图像平滑。 5.Prewitt边缘检测算子对应的模板是和。 -1 -1 -1 -1 0 1 0 0 0 -1 0 1 1 1 1 -1 0 1 (不分先后) 6.图像压缩系统是有编码器和解码器两个截然不同的结构块组成的。 7.灰度直方图的纵坐标是该灰度出现的频率。 8.依据图象的保真度,图象编码可分为无失真(无损)编码和有失真(有损)编码两 种。

机器视觉基本介绍

机器视觉基本概念 2018.1.29 机器视觉系统 作用:利用机器代替人眼来做各种测量和判断。 它是计算机学科的一个重要分支,它综合了光学、机械、电子、计算机软硬件等方面的技术,涉及到计算机、图像处理、模式识别、人工智能、信号处理、光机电一体化等多个领域。 机器视觉系统的特点:是提高生产的柔性和自动化程度。在一些不适合于人工作业的危险工作环境或人工视觉难以满足要求的场合,常用机器视觉来替代人工视觉;同时在大批量工业生产过程中,用人工视觉检查产品质量效率低且精度不高,用机器视觉检测方法可以大大提高生产效率和生产的自动化程度。而且机器视觉易于实现信息集成,是实现计算机集成制造的基础技术。可以在最快的生产线上对产品进行测量、引导、检测、和识别,并能保质保量的完成生产任务 视觉检测:指通过机器视觉产品(即图像摄取装置,分CMOS 和CCD 两种)将被摄取目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号;图像系统对这些信号进行各种运算来抽取目标的特征,进而根据判别的结果来控制现场的设备动作。是用于生产、装配或包装的有价值的机制。它在检测缺陷和防止缺陷产品被配送到消费者的功能方面具有不可估量的价值。 照明 照明是影响机器视觉系统输入的重要因素,它直接影响输入数据的质量和应用效果。由于没有通用的机器视觉照明设备,所以针对每个特定的应用实例,要选择相应的照明装置,以达到最佳效果。 光源可分为可见光和不可见光。常用的几种可见光源是白帜灯、日光灯、水银灯和钠光灯。可见光的缺点是光能不能保持稳定。如何使光能在一定的程度上保持稳定,是实用化过程中急需要解决的问题。另一方面,环境光有可能影响图像的质量,所以可采用加防护屏的方法来减少环境光的影响。 照明系统按其照射方法可分为:背向照明、前向照明、结构光和频闪光照明等。其中,背向照明是被测物放在光源和摄像机之间,它的优点是能获得高对比度的图像。前向照明是光源和摄像机位于被测物的同侧,这种方式便于安装。结构光照明是将光栅或线光源等投射到被测物上,根据它们产生的畸变,解调出被测物的三维信息。频闪光照明是将高频率的光脉冲照射到物体上,摄像机拍摄要求与光源同步。 镜头 FOV(Field of Vision)=所需分辨率*亚象素*相机尺寸/PRTM(零件测量公差比) 镜头选择应注意: ①焦距②目标高度③影像高度④放大倍数⑤影像至目标的距离⑥中心点/节点⑦畸变

机器学习实战之分类算法

机器学习实战之分类算法 第一章机器学习概论 (4) 机器学习基本概念 (4) 机器学习的主要任务以及相应的算法 (4) 如何选择合适的算法? (4) 机器学习应用的步骤 (5) 第二章 K近邻算法(KNN) (5) 工作原理 (5) 实现步骤 (6) K近邻算法的优缺点 (6) 第三章决策树 (7) 基本思路 (7) 集合无序程度测量 (7) 应用场景 (7) 优缺点 (7) 第四章朴素贝叶斯分类 (8) 基本思路 (8) 基本假设 (8) 条件概率 (8) 词袋模型和词集模型 (9) 优缺点 (10) 标称型和数值型数据的区别 (10)

主要应用及步骤 (10) 第五章逻辑回归 (12) 基本思想 (12) 使用场景 (12) 优缺点 (12) Sigmoid函数 (13) 回归系数 (13) 梯度上升法 (14) 特征缺失处理 (14) 标签缺失处理 (14) 第六章支持向量机SVM (14) 基本思想 (14) SVM第一层理解 (15) 超平面的确定 (15) 函数间隔和几何间隔 (15) 最大间隔分类器 (16) SMO优化算法 (16) 核函数 (19) 应用场景 (19) 第七章 AdaBoost分类 (19) Bagging (20) Boosting (20) Adaboost (20) Adaboost的优点 (20)

Adaboost实现步骤 (21) 第八章非均衡分类问题 (23) 分类性能指标 (23) 混淆矩阵 (23) ROC曲线 (24) 处理非均衡问题的数据抽样 (24)

第一章机器学习概论 机器学习基本概念 机器学习就是将无序的数据转化为有用的信息。一个实例有n个特征,由n列组成。机器学习最主要的任务就是分类,另一个就是回归,回归中比较典型的就是线性拟合。分类和回归都属于监督学习,因为这类算法必须知道要预测什么,即已知目标变量的分类信息。与监督学习对应的是无监督学习,此时数据没有类别信息,也不会给定目标值,将数据集合分成由类似的对象组成的多个类的过程叫做聚类。将描述数据统计值的过程称之为密度估计。分类首先要进行训练,训练样本集必须确定目标变量的值,以便发现特征与目标变量之间的关系。特征或者属性通常是训练样本集的列,他们是独立测量得到的结果,多个特征联系在一起共同组成一个训练样本。 机器学习的主要任务以及相应的算法 如何选择合适的算法? 如果要预测目标变量的值:

机器学习算法汇总:人工神经网络、深度学习及其它

学习方式 根据数据类型的不同,对一个问题的建模有不同的方式。在机器学习或者人工智能领域,人们首先会考虑算法的学习方式。在机器学习领域,有几种主要的学习方式。将算法按照学习方式分类是一个不错的想法,这样可以让人们在建模和算法选择的时候考虑能根据输入数据来选择最合适的算法来获得最好的结果。 监督式学习: 在监督式学习下,输入数据被称为“训练数据”,每组训练数据有一个明确的标识或结果,如对防垃圾邮件系统中“垃圾邮件”“非垃圾邮件”,对手写数字识别中的“1“,”2“,”3“,”4“等。在建立预测模型的时候,监督式学习建立一个学习过程,将预测结果与“训练数据”的实际结果进行比较,不断的调整预测模型,直到模型的预测结果达到一个预期的准确率。监督式学习的常见应用场景如分类问题和回归问题。常见算法有逻辑回归(Logistic Regression)和反向传递神经网络(Back Propagation Neural Network) 非监督式学习:

在非监督式学习中,数据并不被特别标识,学习模型是为了推断出数据的一些内在结构。常见的应用场景包括关联规则的学习以及聚类等。常见算法包括Apriori算法以及k-Means算法。 半监督式学习: 在此学习方式下,输入数据部分被标识,部分没有被标识,这种学习模型可以用来进行预测,但是模型首先需要学习数据的内在结构以便合理的组织数据来进行预测。应用场景包括分类和回归,算法包括一些对常用监督式学习算法的延伸,这些算法首先试图对未标识数据进行建模,在此基础上再对标识的数据进行预测。如图论推理算法(Graph Inference)或者拉普拉斯支持向量机(Laplacian SVM.)等。 强化学习:

机器视觉算法开发软件----HALCON

机器视觉算法开发软件----HALCON HALCON是世界范围内广泛使用的机器视觉软件,用户可以利用其开放式结构快速开发图像处理和机器视觉软件。 HALCON提供交互式的编程环境HDevelop。可在Windows,Linux,Unix下使用,使用HDevelop可使用户快速有效的解决图像处理问题。HDevelop含有多个对话框工具,实时交互检查图像的性质,比如灰度直方图,区域特征直方图,放大缩小等,并能用颜色标识动态显示任意特征阈值分割的效果,快速准确的为程序找到合适的参数设置。HDevelop程序提供进程,语法检查,建议参数值设置,可在任意位置开始或结束,动态跟踪所有控制变量和图标变量,以便查看每一步的处理效果。当用户对于机器视觉编程代码完成后,HDevelop可将此部分代码直接转化为C++,C或VB源代码,以方便将其集成到应用系统中。 HALCON提供交互式的模板描述文件生成工具HmatchIt,。可交互式地为一个模型定义一个任意形状的感性趣区域,HmatchIt优化给出此创建模型的合适参数, 自动生成模板描述文件以供程序调用,快速为基于形状匹配和结构匹配的用户找到实现目标识别和匹配应用的合适的参数设置。 HALCON提供支持多CPU处理器的交互式并行编程环境Paralell Develop, 其继承了单处理器板HDevelop的所有特点,在多处理器计算机上会自动将数据比如图像分配给多个线程,每一个线程对应一个处理器,用户无需改动已有的HALCON程序,就立即获得显

著的速度提升。 HALCON中HDevelop Demo中包含680个应用案例,根据不同的工业领域,不同的用法和算法分类列出,用户可以根据自己的需求方便的找到相对应的类似案例,快速掌握其函数用法。 HALCON提供的函数使用说明文档,详细介绍每个函数的功能和参数用法,提供在不用开发语言(VC,VB,.NET等)下的开发手册,而且提供一些算法(例如3D)的原理性介绍,给用户的学习提供帮助。 特点:原型化的开发平台,自动语法检查; 动态察看控制和图标变量; 支持多种操作系统; 支持多CPU; 支持多种文件格式; 自动语言转化功能; 与硬件无关,可支持各种硬件; 应用领域:医学图像分析; 2D/3D测量; 立体视觉; 匹配定位; 光学字符识别; Blob分析;

1模式识别与机器学习思考题及参考答案

模式识别与机器学习期末考查 思考题 1:简述模式识别与机器学习研究的共同问题和各自的研究侧重点。 机器学习是研究让机器(计算机)从经验和数据获得知识或提高自身能力的科学。 机器学习和模式识别是分别从计算机科学和工程的角度发展起来的。然而近年来,由于它们关心的很多共同问题(分类、聚类、特征选择、信息融合等),这两个领域的界限越来越模糊。机器学习和模式识别的理论和方法可用来解决很多机器感知和信息处理的问题,其中包括图像/视频分析、(文本、语音、印刷、手写)文档分析、信息检索和网络搜索等。近年来,机器学习和模式识别的研究吸引了越来越多的研究者,理论和方法的进步促进了工程应用中识别性能的明显提高。 机器学习:要使计算机具有知识一般有两种方法;一种是由知识工程师将有关的知识归纳、整理,并且表示为计算机可以接受、处理的方式输入计算机。另一种是使计算机本身有获得知识的能力,它可以学习人类已有的知识,并且在实践过程中不总结、完善,这种方式称为机器学习。机器学习的研究,主要在以下三个方面进行:一是研究人类学习的机理、人脑思维的过程;和机器学习的方法;以及建立针对具体任务的学习系统。机器学习的研究是在信息科学、脑科学、神经心理学、逻辑学、模糊数学等多种学科基础上的。依赖于这些学科而共同发展。目前已经取得很大的进展,但还没有能完全解决问题。 模式识别:模式识别是研究如何使机器具有感知能力,主要研究视觉模式和听觉模式的识别。如识别物体、地形、图像、字体(如签字)等。在日常生活各方面以及军事上都有广大的用途。近年来迅速发展起来应用模糊数学模式、人工神经网络模式的方法逐渐取代传统的用统计模式和结构模式的识别方法。特别神经网络方法在模式识别中取得较大进展。理解自然语言计算机如能“听懂”人的语言(如汉语、英语等),便可以直接用口语操作计算机,这将给人们带来极大的便利。计算机理解自然语言的研究有以下三个目标:一是计算机能正确理解人类的自然语言输入的信息,并能正确答复(或响应)输入的信息。二是计算机对输入的信息能产生相应的摘要,而且复述输入的内容。三是计算机能把输入的自然语言翻译成要求的另一种语言,如将汉语译成英语或将英语译成汉语等。目前,研究计算机进行文字或语言的自动翻译,人们作了大量的尝试,还没有找到最佳的方法,有待于更进一步深入探索。 机器学习今后主要的研究方向如下: 1)人类学习机制的研究;

机器视觉算法基础(DOC)

机器视觉 基于visual C++ 的数字图像处理

摘要 机器视觉就是用机器代替人眼来做测量和判断。它通过图像摄取装置将被摄取目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号;图像系统对这些信号进行各种运算来抽取目标的特征,进而根据判别的结果来获取信息。本文主要介绍的是数字图像处理中的一些简单应用,通过对图像进行滤波、增强、灰度变换、提取特征等处理来获取图像的信息,达到使图像更清晰或提取有用信息的目的。 关键字:机器视觉、灰度图处理、滤波、边缘提取、连通区域

目录 摘要 (2) 目录 (3) 1 概述 (4) 2技术路线 (4) 3实现方法 (5) 3.1灰度图转换 (5) 3.2 直方图均衡化 (6) 3.3均值滤波和中值滤波 (6) 3.4灰度变换 (7) 3.5拉普拉斯算子 (8) 4 轮廓提取 (9) 5 数米粒数目 (15) 6 存在的问题 ................................................................................................ 错误!未定义书签。 7 总结 ............................................................................................................ 错误!未定义书签。 8 致谢 ............................................................................................................ 错误!未定义书签。参考文献 . (17)

机器学习10大经典算法.

1、C4.5 机器学习中,决策树是一个预测模型;他代表的是对象属性与对象值之间的一种映射关系。树中每个节点表示某个对象,而每个分叉路径则代表的某个可能的属性值,而每个叶结点则对应从根节点到该叶节点所经历的路径所表示的对象的值。决策树仅有单一输出,若欲有复数输出,可以建立独立的决策树以处理不同输出。从数据产生决策树的机器学习技术叫做决策树学习, 通俗说就是决策树。 决策树学习也是数据挖掘中一个普通的方法。在这里,每个决策树都表述了一种树型结构,他由他的分支来对该类型的对象依靠属性进行分类。每个决策树可以依靠对源数据库的分割进行数据测试。这个过程可以递归式的对树进行修剪。当不能再进行分割或一个单独的类可以被应用于某一分支时,递归过程就完成了。另外,随机森林分类器将许多决策树结合起来以提升分类的正确率。决策树同时也可以依靠计算条件概率来构造。决策树如果依靠数学的计算方法可以取得更加理想的效果。决策树一般都是自上而下的来生成的。 选择分割的方法有好几种,但是目的都是一致的:对目标类尝试进行最佳的分割。从根到叶子节点都有一条路径,这条路径就是一条“规则”。决策树可以是二叉的,也可以是多叉的。对每个节点的衡量: 1)通过该节点的记录数 2)如果是叶子节点的话,分类的路径 3)对叶子节点正确分类的比例。 有些规则的效果可以比其他的一些规则要好。由于ID3算法在实际应用中存在一些问题,于是Quilan提出了C4.5算法,严格上说C4.5只能是ID3的一个改进算法。相信大家对ID3算法都很.熟悉了,这里就不做介绍。 C4.5算法继承了ID3算法的优点,并在以下几方面对ID3算法进行了改进: 1) 用信息增益率来选择属性,克服了用信息增益选择属性时偏向选择取值多的属性的不足; 2) 在树构造过程中进行剪枝; 3) 能够完成对连续属性的离散化处理; 4) 能够对不完整数据进行处理。

1模式识别与机器学习思考题和参考答案

模式识别和机器学习期末考查 思考题 1:简述模式识别和机器学习研究的共同问题和各自的研究侧重点。 机器学习是研究让机器(计算机)从经验和数据获得知识或提高自身能力的科学。 机器学习和模式识别是分别从计算机科学和工程的角度发展起来的。然而近年来,由于它们关心的很多共同问题(分类、聚类、特征选择、信息融合等),这两个领域的界限越来越模糊。机器学习和模式识别的理论和方法可用来解决很多机器感知和信息处理的问题,其中包括图像/视频分析、(文本、语音、印刷、手写)文档分析、信息检索和网络搜索等。近年来,机器学习和模式识别的研究吸引了越来越多的研究者,理论和方法的进步促进了工程使用中识别性能的明显提高。 机器学习:要使计算机具有知识一般有两种方法;一种是由知识工程师将有关的知识归纳、整理,并且表示为计算机可以接受、处理的方式输入计算机。另一种是使计算机本身有获得知识的能力,它可以学习人类已有的知识,并且在实践过程中不总结、完善,这种方式称为机器学习。机器学习的研究,主要在以下三个方面进行:一是研究人类学习的机理、人脑思维的过程;和机器学习的方法;以及建立针对具体任务的学习系统。机器学习的研究是在信息科学、脑科学、神经心理学、逻辑学、模糊数学等多种学科基础上的。依赖于这些学科而共同发展。目前已经取得很大的进展,但还没有能完全解决问题。 模式识别:模式识别是研究如何使机器具有感知能力,主要研究视觉模式和听觉模式的识别。如识别物体、地形、图像、字体(如签字)等。在日常生活各方面以及军事上都有广大的用途。近年来迅速发展起来使用模糊数学模式、人工神经网络模式的方法逐渐取代传统的用统计模式和结构模式的识别方法。特别神经网络方法在模式识别中取得较大进展。理解自然语言计算机如能“听懂”人的语言(如汉语、英语等),便可以直接用口语操作计算机,这将给人们带来极大的便利。计算机理解自然语言的研究有以下三个目标:一是计算机能正确理解人类的自然语言输入的信息,并能正确答复(或响应)输入的信息。二是计算机对输入的信息能产生相应的摘要,而且复述输入的内容。三是计算机能把输入的自然语言翻译成要求的另一种语言,如将汉语译成英语或将英语译成汉语等。目前,研究计算机进行文字或语言的自动翻译,人们作了大量的尝试,还没有找到最佳的方法,有待于更进一步深入探索。 机器学习今后主要的研究方向如下: 1)人类学习机制的研究; 2)发展和完善现有学习方法,建立实用的学习系统,特别是开展多种学习方法协同工作的集成化系统的研究;通过多个现有的具体例子进行分析,归纳为更一般的概念.机器学习所关注的一个根本问题是如何提高学习系统的泛化能力,或者说

轻松看懂机器学习十大常用算法知识分享

轻松看懂机器学习十大常用算法

通过本篇文章可以对ML的常用算法有个常识性的认识,没有代码,没有复杂的理论推导,就是图解一下,知道这些算法是什么,它们是怎么应用的,例子主要是分类问题。 每个算法都看了好几个视频,挑出讲的最清晰明了有趣的,便于科普。 以后有时间再对单个算法做深入地解析。 今天的算法如下: 1.决策树 2.随机森林算法 3.逻辑回归 4.SVM 5.朴素贝叶斯 6.K最近邻算法 7.K均值算法 8.Adaboost 算法 9.神经网络 10.马尔可夫 1. 决策树

根据一些 feature 进行分类,每个节点提一个问题,通过判断,将数据分为两类,再继续提问。这些问题是根据已有数据学习出来的,再投入新数据的时候,就可以根据这棵树上的问题,将数据划分到合适的叶子上。 2. 随机森林 视频 在源数据中随机选取数据,组成几个子集 S 矩阵是源数据,有 1-N 条数据,A B C 是feature,最后一列C是类别

由 S 随机生成 M 个子矩阵 这 M 个子集得到 M 个决策树 将新数据投入到这 M 个树中,得到 M 个分类结果,计数看预测成哪一类的数目最多,就将此类别作为最后的预测结果

3. 逻辑回归 视频 当预测目标是概率这样的,值域需要满足大于等于0,小于等于1的,这个时候单纯的线性模型是做不到的,因为在定义域不在某个范围之内时,值域也超出了规定区间。 所以此时需要这样的形状的模型会比较好

那么怎么得到这样的模型呢? 这个模型需要满足两个条件大于等于0,小于等于1 大于等于0 的模型可以选择绝对值,平方值,这里用指数函数,一定大于0 小于等于1 用除法,分子是自己,分母是自身加上1,那一定是小于1的了 再做一下变形,就得到了 logistic regression 模型

机器学习算法优缺点改进总结

Lecture 1 Introduction to Supervised Learning (1)Expectatin Maximization(EM) Algorithm (期望值最大) (2)Linear Regression Algorithm(线性回归) (3)Local Weighted Regression(局部加权回归) (4)k-Nearest Neighbor Algorithm for Regression(回归k近邻) (5)Linear Classifier(线性分类) (6)Perceptron Algorithm (线性分类) (7)Fisher Discriminant Analysis or Linear Discriminant Analysis(LDA) (8)k-NN Algorithm for Classifier(分类k近邻) (9)Bayesian Decision Method(贝叶斯决策方法) Lecture 2 Feed-forward Neural Networks and BP Algorithm (1)Multilayer Perceptron(多层感知器) (2)BP Algorithm Lecture 3 Rudiments of Support Vector Machine (1)Support Vector Machine(支持向量机) (此算法是重点,必考题) 此处有一道必考题 Lecture 4 Introduction to Decision Rule Mining (1)Decision Tree Algorithm (2)ID3 Algorithm (3)C4.5 Algorithm (4)粗糙集…… Lecture 5 Classifier Assessment and Ensemble Methods (1)Bagging (2)Booting (3)Adaboosting Lecture 6 Introduction to Association Rule Mining (1)Apriori Algorithms (2)FP-tree Algorithms Lecture 7 Introduction to Custering Analysis (1)k-means Algorithms (2)fuzzy c-means Algorithms (3)k-mode Algorithms (4)DBSCAN Algorithms Lecture 8 Basics of Feature Selection (1)Relief Algorithms (2)ReliefF Algorithms

相关文档

- 机器学习算法一览

- 机器学习算法汇总大全

- 机器学习汇总概述.

- 机器学习10大算法-周辉

- 机器学习算法汇总大全

- 机器学习算法汇总:人工神经网络、深度学习及其它

- 斯坦福大学机器学习梯度算法总结

- 经典的机器学习算法汇总

- 三分钟解读机器学习及其算法汇总

- 机器学习常见算法分类汇总

- 轻松看懂机器学习十大常用算法知识分享

- 机器学习十大算法:AdaBoost

- 机器学习算法总结 决策树(含代码)

- 机器学习的9个基础概念和10种基本算法总结

- 机器学习算法介绍整理

- 机器学习算法总结

- 机器学习常见算法分类

- 机器学习的十种经典算法详解

- 机器学习10大经典算法.

- 机器学习knn分类算法精品PPT课件

最新文档

- 南岭地区钨矿床共(伴)生金属特征及其地质意义

- 中国锑矿矿床类型

- 湖南省主要成矿作用与矿床成矿系列

- 中国典型锑矿区

- 沃溪矿区探边找盲与外围找矿初探

- 湖南安化廖家坪锑金钨矿床地质特征及找矿方向

- 湘西溆浦龙王江矿区金锑矿床地质特征分析及找矿远景

- 湖南龙王江锑砷金矿床地质地球化学特征、成矿分析与找矿

- 行政年终述职报告ppt

- 护士年终述职报告ppt

- ppt述职报告4篇

- 年终述职报告ppt模板

- 年终工作总结述职报告ppt

- 行政年终述职报告ppt

- 某公路工程监理月报

- 监理月报(市政道路工程)

- 公路工程监理月报

- 南宁市凤凰江沙井大道生态环境综合整治定津路桥工程监理月报

- 公路工程水土保持监理月报

- 邢汾高速公路邢台西环连接线总监办工程监理月报